Установка Claude Code на Ubuntu 24.04 — процесс довольно прямолинейный, но требующий аккуратности с версиями Node.js и правами доступа. Как «самоучка», я рекомендую использовать официальный скрипт установки или NPM, но без использования sudo для самого пакета, чтобы избежать проблем с правами в будущем.

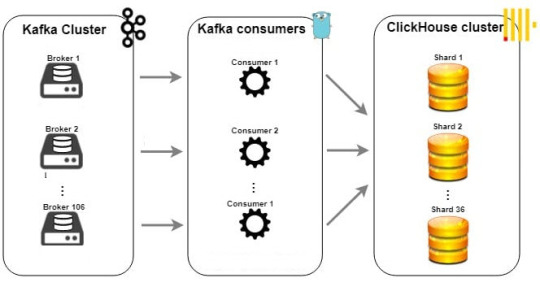

Claude Code - это специализированный CLI-инструмент от Anthropic, превращающий языковую модель Claude 3.5 Sonnet в автономного агента. Программа работает непосредственно в терминале, имея доступ к файловой системе и инструментам разработки. В инфраструктуре Yandex Cloud это позволяет автоматизировать сложные задачи: от написания Airflow DAGs до администрирования баз данных ClickHouse.

Архитектура и системные требования для установки Claude code под Ubuntu 24

Claude Code функционирует как агентная надстройка над стандартной оболочкой Shell. Основное отличие от чат-ботов заключается в способности инструмента самостоятельно выполнять команды и анализировать их вывод.

Для успешной работы архитектура решения должна включать следующие компоненты:

Node.js Runtime. Среда исполнения для самого CLI-приложения.

Git. Необходим для индексации проекта и понимания контекста изменений.

Сетевой мост (Proxy). Обязателен для обхода региональных блокировок API Anthropic.

Инструмент предъявляет высокие требования к качеству окружения. На Ubuntu 24.04 рекомендуется использовать только LTS-версии Node.js для обеспечения стабильности сетевых сокетов.

Установка и настройка Claude Code для кодогенерации

Ниже — пошаговый алгоритм, который гарантированно заведет агента на твоей машине.

Для начала убедимся, что в системе есть базовые утилиты для загрузки и работы с репозиториями.

sudo apt update && sudo apt upgrade -y

sudo apt install -y curl ca-certificates gnupg build-essential

Шаг 1: Установка Node.js и исправление прав доступа

Стандартные репозитории Ubuntu часто содержат устаревшие версии Node.js. Мы будем использовать официальный репозиторий NodeSource для установки версии 22. Выполните последовательно следующие команды для подготовки среды:

# Добавление репозитория NodeSource

curl -fsSL https://deb.nodesource.com/setup_22.x | sudo -E bash -

sudo apt install -y nodejs

# Проверка установленных версий

node -v # Должно быть v22.x

npm -v # Должно быть 10.x или выше

Часто при глобальной установке пакетов возникает ошибка EACCES. Она связана с отсутствием прав на запись в системные папки, NPM пытается вломиться в системную папку /usr/lib/node_modules, на которую у обычного пользователя ubuntu нет прав. Хотя ошибка и предлагает использовать sudo, крайне не рекомендуется этого делать для Claude Code. Это может привести к тому, что агент не сможет записывать логи или обновляться. Давай сделаем по-красоте! Перенастроим NPM, чтобы он устанавливал глобальные пакеты в твою домашнюю папку. Это «золотой стандарт» для работы на Linux.

# Создание папки для глобальных пакетов в домашней директории

mkdir ~/.npm-global

npm config set prefix ’~/.npm-global’

# Добавление пути в конфигурацию оболочки

echo “export PATH=$PATH:~/.npm-global/bin”| tee –append ~/.bashrc

source ~/.bashrc

Теперь установка Claude Code пройдет без использования sudo, что является критически важным для безопасности агента.

npm install -g @anthropic-ai/claude-code

claude –version

Данная последовательность действий гарантирует, что агент сможет корректно сохранять свои логи и конфигурационные файлы.

Шаг 2: Настройка прокси-сервера Dante (SOCKS5) для работы Claude Code

Одной из главных сложностей при работе из Yandex Cloud является региональная блокировка API Anthropic. При попытке прямого обращения серверы Cloudflare возвращают ошибку 403. Поскольку API Anthropic блокирует запросы из некоторых регионов, необходимо поднять прокси-сервер на VPS в разрешенной зоне (например, Beget в Латвии, Free Tier AWS). Мы будем использовать Dante и настроим White List для вашего IP из Yandex Cloud.

Установим Dante сервис на удаленном сервере в разрешенной зоне

sudo apt update && sudo apt install dante-server -y

На сервере отредактируйте файл /etc/danted.conf следующим образом :

logoutput: /var/log/danted.log

user.privileged: root

user.unprivileged: nobody

# Порт и адрес, который слушаем

internal: 0.0.0.0 port = 1080

# Твой внешний интерфейс (проверь через ip -br a)

external: eth0

# Методы аутентификации

socksmethod: none

clientmethod: none

# Блок 1: Кому разрешено подключаться к серверу

client pass {

from: 51.250.13.72/32 to: 0.0.0.0/0

log: error connect

}

# Блок 2: Кому разрешено проксировать трафик

socks pass {

from: 51.250.13.72/32 to: 0.0.0.0/0

log: error connect

}

Вместо адреса 51.250.13.72 подставьте свой адрес определив его с помощью curl ifconfig.me на своем сервере в Yandex Cloud. После правки перезапустите сервис командой sudo systemctl restart danted. Такая конфигурация делает ваш прокси невидимым для всех, кроме вашей рабочей станции. Это исключает возможность брутфорса и несанкционированного использования трафика. Даже если Dante настроен, лучше закрыть порт на уровне ядра системы. Мы воспользуемся ufw (Uncomplicated Firewall) — это проще всего на Ubuntu.

#–Настройка сетевого экрана (Firewall) на Beget

#– Разреши SSH, чтобы не потерять доступ к серверу

sudo ufw allow ssh

#– Разреши доступ к порту 1080 только для твоего IP

sudo ufw allow from 51.250.13.72 to any port 1080

#– Включи Firewall

sudo ufw enable

Шаг 3: Настройка клиента Proxychains4 для подключения к Anthropic

На машине в Yandex Cloud нам нужно заставить Claude Code работать через латвийский прокси. Лучшим инструментом для этого является proxychains4. Установите утилиту и внесите правки в её конфигурацию:

sudo apt install proxychains4 -y

sudo vim /etc/proxychains4.conf

В самом конце файла, в секции , удалите стандартные строки и добавьте адрес вашего Beget-сервера ( замените на свой IP):

#socks4 213.XX.XX.XX 9050

socks5 213.XX.XX.XX 1080

Проверьте работоспособность канала связи перед запуском основного инструмента. Команда proxychains4 curl -I https://api.anthropic.com должна вернуть статус HTTP 400 или 401.

Если вы видите OK в логах proxychains, значит, сетевой туннель между Яндексом и Латвией работает исправно.

Шаг 4: Практические примеры использования Claude Code для кодогенерации с Airflow и ClickHouse

После настройки Claude Code может выполнять роль Senior Data Engineer. Он понимает структуру специфических фреймворков и баз данных.

Автоматизация Apache Airflow

Вы можете поручить агенту написание и проверку сложных DAG-файлов.

# Пример запроса к агенту

proxychains4 claude –edit “Создай Airflow DAG в папке dags/s3_export.py.

Используй S3ToClickHouseOperator. Настрой расписание на каждые 4 часа.”

Агент сам найдет нужные импорты и проверит синтаксис Python, настроит Connections и docker compose файлы и запустит на исполнение. Если в коде будут ошибки, он увидит их при попытке “прогнать” файл через интерпретатор.

Работа с ClickHouse через SQL

Claude Code умеет писать оптимизированные запросы, если вы предоставите ему схему таблиц.

# Запрос на оптимизацию

proxychains4 claude “Проанализируй схему таблицы ‘events’ в ClickHouse.

Предложи оптимальный ключ сортировки для ускорения фильтрации по user_id.”

Инструмент анализирует кардинальность данных и предлагает решения на основе лучших практик (например, использование проекций или материализованных представлений). Для эффективного взаимодействия с СУБД вроде ClickHouse используется Model Context Protocol (MCP). Этот протокол дает Claude возможность «видеть» схему таблиц и выполнять SQL-запросы напрямую.

Более подробно о возможностях взаимодействия вы можете познакомиться на курсах ClickHouse Построение DWH и Практический курс Apache Airflow для инженеров данных

Заключение

Интеграция Claude Code в Yandex Cloud - это задача на стыке DevOps и Data Engineering. Правильная настройка прокси-сервера и прав Node.js превращает стандартный терминал в мощную интеллектуальную среду. Агент берет на себя рутину, позволяя инженеру сфокусироваться на архитектурных решениях.

Референсные ссылки

(https://docs.anthropic.com/en/docs/agents-and-tools/claude-code)

(https://www.inet.no/dante/doc/1.4.x/config/auth_none.html)

(https://docs.npmjs.com/resolving-eacces-permissions-errors-when-installing-packages-globally)

(https://cloud.yandex.ru/docs/vpc/concepts/network)